AnyBackup 7.0 新一代重复数据删除技术

AnyBackup 7.0 采用爱数第四代重复数据删除技术,支持源端重复数据删除、并行重删方案,在备份数据传输到存储介质之前执行重删操作,大幅度提升备份性能。

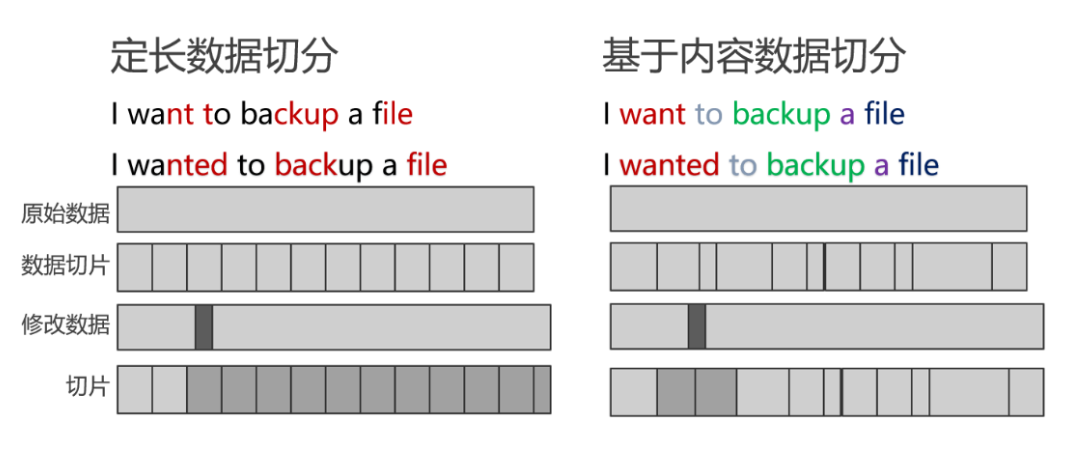

基于内容的变长数据切分

AnyBackup 7.0 第四代重复数据删除技术使用基于内容的变长数据切分算法。该算法可以智能识别已修改的数据和未修改的数据,从而避免因修改数据位移而导致的未修改数据切分到新数据块中的问题,最大限度地提升重删性能和重删率,目的在于不备份任意一个冗余数据。与定长切片算法相比,基于内容的变长切片方式能够达到更高的数据去重比率。而定长切片按照固定大小切分文件或数据源,如果一个文件在文件开始新增或减少一个字符,将导致所有切片的指纹发生变化,最差的结果是备份两个仅差一个字符的文件,导致重删率为0。

源端重复数据删除

重复数据删除的工作流程如下所示:

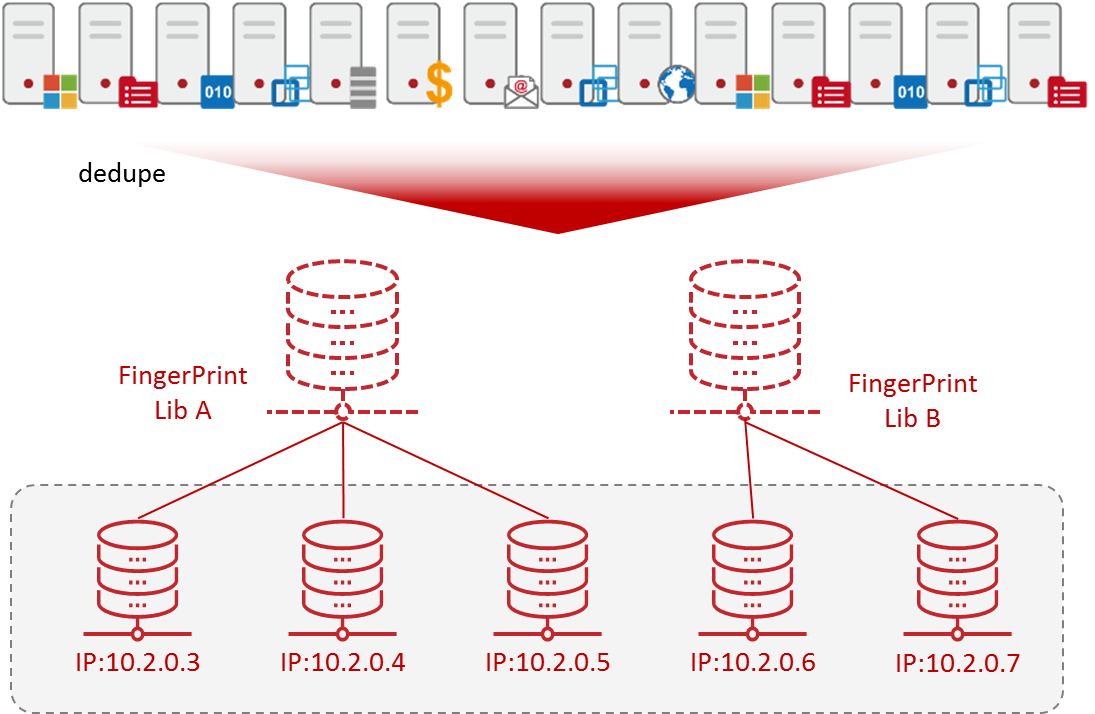

并行重删

AnyBackup 7.0 采用并行重删技术,通过在多个不同的节点上构建指纹库,并将指纹并行分布于多个节点,有效解决单点性能和存储空间压力问题。

传统重删方式采用磁盘读写指纹方式,会产生大量的随机 IO,严重影响性能。而 AnyBackup 7.0 并行重删技术采用内存级指纹库进行重删,所有指纹读写全部保存于内存中,从而提升指纹查询和处理效率,并且减少了因磁盘中指纹库增大所导致的随机IO压力。当指纹库不再需要进行备份时,将指纹同步到磁盘当中。指纹库构建在不同重删节点上,而生产数据可以基于多个不同的指纹库,执行并行重删。

通过指纹库策略,可以将重复利用的数据按顺序、连续地保存在同一个空间内。如此,即可实现:

一,可以减少全局重删时每次都要查找全部指纹的时间损耗;

二,可以最大限度利用存储的读缓存机制,尽量减少因随机读磁盘引起的频繁磁盘寻道的切换,提升恢复效率。

重复删除技术如何提高备份性能?

当前快速增长的数据对于企业来说,重复删除技术能在有限的备份窗口内,确保大规模数据量备份顺利完成。

- 并行重删:可适用于更大数据量的备份场景,重删比例更高,备份窗口更小。

- 多重删节点:指纹库由多个重删节点组成,线性提升了单个指纹库的重删容量。重删节点的分配遵循负载均衡原则,平均分配节点资源,避免出现超负荷、或资源闲置的现象。

- 源端重删:备份时传输的数据为已完成源端重删的数据,能够极大地降低对业务带宽的占用,提升备份效率,缩短备份窗口。

随着环境的增长,容量和扩展性问题怎么解决?

随着数据的增长,对容量和扩展都有了更多的要求,此时需要新的特性来满足这些需求。

随着数据的增长,对容量和扩展都有了更多的要求,此时需要新的特性来满足这些需求。

- 横向扩展:最大可扩展至32个节点,以满足海量数据保护的需求。

- 指纹库灵活选择机制:多个相同应用类型的备份任务可共用一个指纹库,这些任务重删后的数据及指纹是共享的,可用于不同任务的恢复,大幅度提升重删率,减少需存储的备份数据。对于不同应用类型的备份任务,提供不同的指纹库,不同应用类型的备份任务各自使用独立的指纹库,从而减少指纹比对时间,加速指纹查询效率,降低内存占用,并将整个数据中心的重删性能、重删比率及所需资源均衡至一个最佳值,达到最优效果。

- 冗余数据自动清理:基于副本数据保护策略,历史副本逐渐会被淘汰成为冗余数据。当冗余数据达到一定规模时,系统将自动清理存储中的冗余数据,并整理有效数据,回收空间,提升空间利用率。

如何提高投资回报率的同时减少相应的风险?

- 降低存储成本:重删率最高可达99%,从而大幅度减少备份数据总量,降低备份数据所占用的存储空间,提升存储设备的利用率,提高每GB存储的利用价值。

- 不争用业务系统资源:源端重删所占用的客户端资源较少,因而对业务系统影响降到最低。

赞

点个赞吧!

请就本文对您的益处进行评级: